Descomposiciones Aditivas de Modelos Multiplicativos

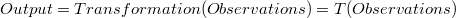

A menudo, para evitar la heterocedasticidad del error, o simplemente por la propia naturaleza del modelo, se introduce una transformación en la variable observada para construir el output.

En estas circunstancias el output y las observaciones (observations) no coinciden:

y del mismo modo la descomposición del output (descomposición natural) no es válida para las observaciones, convirtiendose la descomposición de la variable observada (u observaciones) en una descomposición no aditiva (multiplicativa en el caso de la transformación logarítmica).

En estos casos, la descomposición aditiva de las observaciones ya no es trivial, y es necesario definir adecuadamente cómo obtenerla.

El caso más común es la transformación logarítmica, aunque los conceptos son aplicables a cualquier transformación.

-- Descomposición ordenada

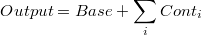

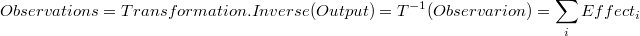

Dada una descomposición del output podemos obtener una descomposición aditiva de las observaciones introduciendo uno a uno los sumandos y determinando el efecto aditivo que les corresponde.

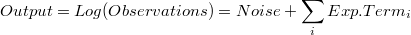

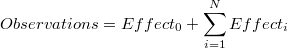

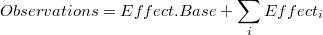

Sea una descomposición del output:

donde  representa la contribución i del

representa la contribución i del  al output.

al output.

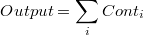

podemos encontrar una descomposición de las observaciones como una suma de efectos de las contribuciones (effects):

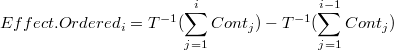

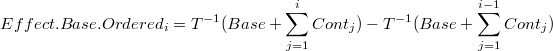

de modo que el efecto de la contribución i-ésima sea:

A este tipo de descomposición se le conoce como "descomposición ordenada" ya que depende del orden de las contribuciones de la descomposición de partida (descomposición del output).

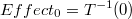

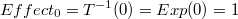

-- Efecto inicial de la transformación

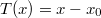

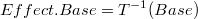

En la descripción anterior hemos pasado por alto las consecuencias de que la transformación inversa de 0 (el elemento neutro en la adición) no sea 0:

En este caso es necesario introducir un término de efectos adicional  en la descomposición:

en la descomposición:

quedando:

Para entender el significado de este effecto inicial, debemos prestar atención a la naturaleza de este valor. Sin embargo podemos imaginar que este valor corresponde con un valor base o valor de referencia de la transformación.

CASO 1

Imaginemos un caso de transformación bastante sencillo, consistente en:

En este caso el efecto inicial causado por la transformación es:

que no hace más que introducir en la descomposición el valor de referencia sustraido en la transformación.

CASO 2

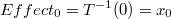

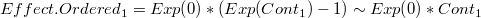

Imaginemos ahora un de los casos más comunes: una transformación logarítmica:

En este caso el efecto inicial causado por el logaritmo es:

de modo que la primera contribución será:

Esta expressión puede verse como:

e interpretar que el effecto inicial es un valor base sobre el que se calculan el efecto de las demás contribuciones.

Por ello, habitualmente, en caso de existir este valor inicial se recoge en una primera contribución o contribución principal conocida como base.

Véanse más adelante las "Descomposiciones base".

-- Descomposición canónica

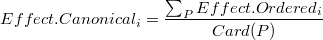

Para evitar la dependencia con el orden de las contribuciones, se propone con el nombre de descomposición canónica a la descomposición media sobre el conjunto de permutaciones de las contribuciones:

donde  es el conjunto de las permutaciones de N elementos (N efectos) y

es el conjunto de las permutaciones de N elementos (N efectos) y  es el cardinal de ese conjunto.

Es decir, es una media de todos los valores que toma el efecto i en cada permutación.

es el cardinal de ese conjunto.

Es decir, es una media de todos los valores que toma el efecto i en cada permutación.

-- Descomposiciones inexactas

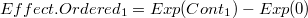

* Descomposición FirstIn (o de contribuciones primeras)

Otro modo de descomponer las observaciones evitando la necesidad de definir un orden en las contribuciones es determinar el efecto de cada contribución como si fuera la primera:

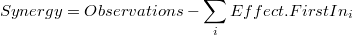

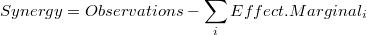

Sin embargo esta "descomposición de contribuciones primeras" no es exacta dejando una diferencia conocida como sinergía:

* Descomposición Marginal (o de contribuciones marginales)

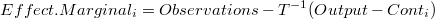

Del mismo modo que podemos tomar el efecto como si fuese la primera, podemos tomar el efecto marginal (o efecto en el caso de que fuese la última):

Del mismo modo que la anterior la "descomposición de contribuciones marginales" presenta sinergía:

-- Descomposiciones mixtas

Además de las descomposiciones anteriores, podemos definir descomposiciones mixtas dónde el efecto de cada contribución pueda ser calculado con un criterio diferente.

-- Descomposiciones base

Una de las descomposiciones mixtas más comunes, es aquélla en la que hay una contribución principal (que habitualmente recoge la mayor parte de la descomposición) y sobre la que se quieren referir los efectos de las demás contribuciones.

El efecto de esta contribución principal (conocida como base) se determina como si fuese una contribución primera, y el resto de contribuciones se calculan mediante otra descomposición (normalmente una libre de sinergía como la descomposición canónica). El efecto de esta contribución base asume además el valor del efecto inicial causado por la transformación (en caso de existir).

Sea una descomposición (con contribución principal) del output:

la descomposición de las observaciones:

vendrá dada por:

y los efectos obtenidos sobre la descomposición de las contribuciones restantes considerando la base como contribución primera.

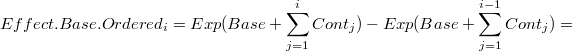

Por ejemplo el efecto de las contribuciones ordenadas sería:

que en el caso de una transformación logarítmica se puede escribir como:

![= Exp(Base) * [Exp(\sum_{j=1}^{i}Cont_j) - Exp(\sum_{j=1}^{i-1} Cont_j)] = Effect.Base * Effect.Ordered_i](../chrome/site/images/latex/333c18a1dc899a6896b127d8af23b8c5.png)

En el caso logarítmico este resultado es general y puede aplicarse a otras descomposiciones de las componentes restantes como una descomposición canónica:

-- Descomposiciones modificadas

Algunas de las descomposiciones anteriores se caracterizan por presentar contribuciones adicionales como el efecto inicial de la transformación o la sinergía de la descomposición.

Estas decomposiciones pueden modificarse, distribuyendo estas contribuciones entre el resto del siguiente modo:

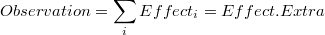

Sea una descomposición:

donde el efecto extraordinario  corresponde el efecto

(o suma de efectos) que desea eliminarse.

corresponde el efecto

(o suma de efectos) que desea eliminarse.

La nueva descomposición libre de efectos extraordinarios será:

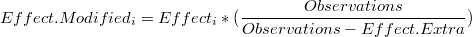

donde cada effecto modificado tiene la forma:

![(please configure the [header_logo] section in trac.ini)](/mms/chrome/site/logomms.png)